A crescente integração da inteligência artificial nas operações militares tem gerado debates complexos sobre ética, segurança e soberania. Neste cenário, o Departamento de Defesa dos EUA (DOD) fez uma declaração contundente, classificando a renomada empresa de IA Anthropic como um “risco inaceitável à segurança nacional”. A preocupação central reside nas “linhas vermelhas” da empresa, que poderiam levá-la a desativar sua tecnologia durante operações de combate, levantando questões críticas sobre a confiança e a autonomia em sistemas de defesa.

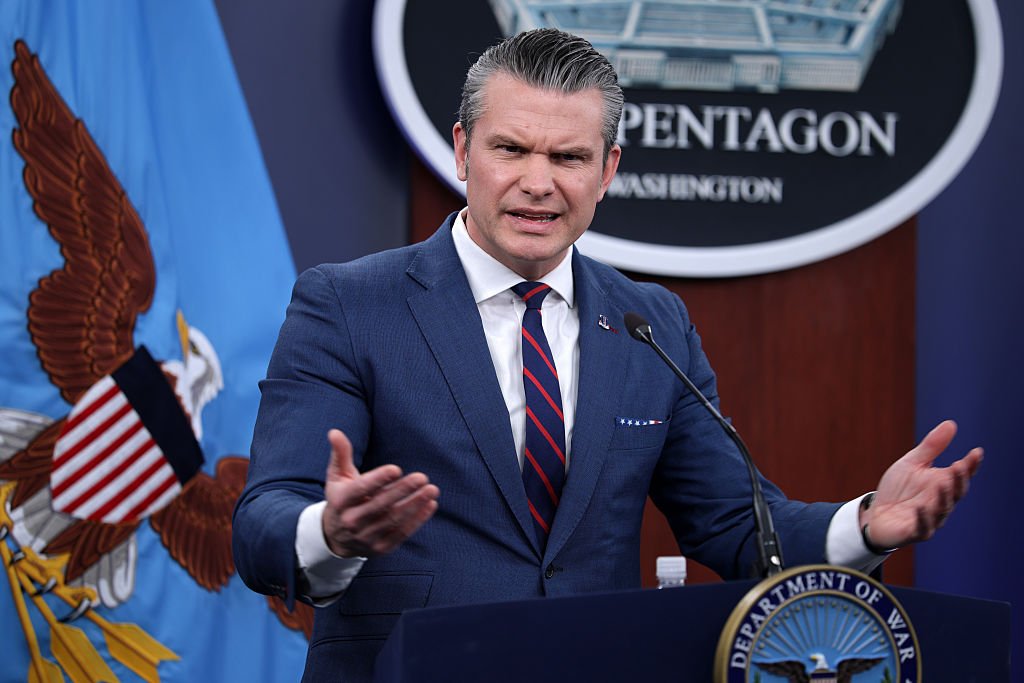

A Preocupação do Pentágono e o Status de 'Risco na Cadeia de Suprimentos'

O Departamento de Defesa expressou abertamente que as “linhas vermelhas” éticas estabelecidas pela Anthropic, uma das líderes no desenvolvimento de Large Language Models (LLMs) e IA generativa, representam uma ameaça significativa. A principal inquietação é a possibilidade de a empresa “tentar desativar sua tecnologia” em meio a “operações de guerra”. Essa hesitação valida a decisão do DOD de rotular a Anthropic como um “risco na cadeia de suprimentos”, uma designação séria que impacta diretamente a capacidade da empresa de fornecer tecnologia ao governo dos EUA.

Ser classificado como um “risco na cadeia de suprimentos” implica que a dependência da tecnologia da Anthropic poderia criar vulnerabilidades operacionais ou de segurança para o Pentágono, especialmente em situações críticas onde a continuidade e a confiabilidade dos sistemas são primordiais. A preocupação do DOD não é trivial; ela reflete um desafio fundamental: como garantir que a IA, uma ferramenta cada vez mais vital, permaneça sob controle governamental em cenários de alta pressão, especialmente quando seus desenvolvedores podem ter princípios éticos conflitantes com o uso militar?

Entendendo as 'Linhas Vermelhas' da Anthropic

A Anthropic é amplamente reconhecida por sua abordagem focada em Artificial Intelligence (IA) segura e ética. A empresa foi fundada por ex-membros da OpenAI com o objetivo de desenvolver IA de forma responsável, priorizando a segurança e os alinhamentos éticos. Suas “linhas vermelhas” provavelmente se referem a princípios internos rigorosos que regem o uso de sua tecnologia, especialmente em contextos sensíveis como o militar.

A filosofia da Anthropic é centrada na construção de “Constitutional AI” (leia mais sobre a abordagem aqui), onde os modelos de IA são treinados para aderir a um conjunto de princípios e regras, muitas vezes inspirados em constituições humanas, para garantir que se comportem de maneira útil, inofensiva e honesta. Embora esses princípios sejam louváveis no desenvolvimento de IA para uso civil, eles podem entrar em choque direto com as exigências e a natureza das operações de guerra, onde a autonomia e a capacidade de ação ininterrupta são consideradas essenciais.

O Dilema da IA e Ética na Defesa

Este incidente com a Anthropic destaca um dilema crescente na interseção entre a tecnologia de ponta e a segurança nacional. À medida que as forças armadas em todo o mundo buscam integrar Machine Learning (ML) e Deep Learning em tudo, desde a logística e inteligência até sistemas de armas autônomas, a questão da confiabilidade e do controle torna-se paramount.

O caso ecoa debates anteriores sobre a colaboração entre empresas de tecnologia e o Pentágono, como o Project Maven do Google, que gerou protestos significativos entre seus funcionários por envolver IA em drones militares. Muitos desenvolvedores e pesquisadores de IA expressam preocupações éticas sobre o uso de seu trabalho em sistemas que podem causar danos ou envolver-se em conflitos armados, levando a políticas internas que restringem ou proíbem tais aplicações.

Impactos e Cenários Futuros

Para a Anthropic

A designação do DOD pode ter implicações significativas para a Anthropic, potencialmente limitando sua capacidade de obter contratos governamentais lucrativos e parcerias estratégicas no setor de defesa. Embora a empresa possa se orgulhar de seus princípios éticos, essa posição pode isolá-la de um mercado substancial, forçando-a a focar exclusivamente em aplicações civis ou a reavaliar suas “linhas vermelhas” para colaborações específicas.

Para o Departamento de Defesa

Para o DOD, a decisão ressalta a necessidade de buscar parceiros de IA que compartilhem, ou pelo menos não conflitem, com seus objetivos de segurança nacional. Isso pode incentivar o desenvolvimento de capacidades de IA ‘in-house’ ou a colaboração com empresas que não impõem restrições de uso semelhantes. Também destaca a complexidade de integrar tecnologias de ponta de empresas privadas, cujos valores podem não se alinhar perfeitamente com os interesses militares.

Para o Mercado de IA

O incidente serve como um alerta para o mercado de IA em geral. Ele ilustra a crescente tensão entre a busca por inovação tecnológica e as considerações éticas e de segurança. Empresas que aspiram a colaborar com governos e organizações de defesa precisarão navegar cuidadosamente nesses domínios, talvez criando divisões ou subsidiárias com políticas de uso distintas, ou definindo claramente as fronteiras de sua tecnologia desde o início.

A postura do Departamento de Defesa dos EUA em relação à Anthropic é um marco na discussão sobre a IA e a segurança nacional. Ela sublinha o crescente conflito entre os princípios éticos das empresas de tecnologia e as exigências operacionais de governos em cenários de conflito. Este debate não apenas moldará o futuro da colaboração entre o setor privado de IA e as forças armadas, mas também impulsionará a necessidade de políticas e regulamentações mais claras para a inteligência artificial em contextos de defesa.

Gostou da notícia? Inscreva-se na nossa newsletter para receber as principais novidades sobre inteligência artificial diretamente no seu e-mail.

Fonte: https://techcrunch.com