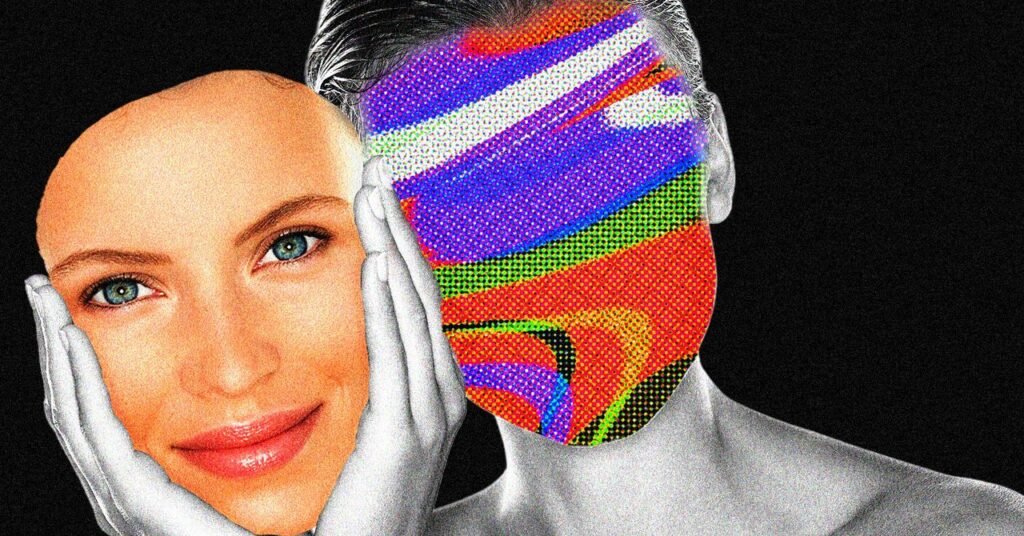

O avanço da Inteligência Artificial (AI) abre portas para inovações incríveis, mas também para novas e sofisticadas formas de golpe. Uma investigação recente da WIRED revelou uma tendência preocupante: o recrutamento de ‘modelos de rosto de IA’ em canais do Telegram, principalmente mulheres, que estão sendo usadas para dar uma fachada humana a esquemas fraudulentos, com alguns relatos indicando até 100 videochamadas por dia. Esse cenário expõe uma nova dimensão da engenharia social, onde a linha entre o real e o artificial se torna cada vez mais tênue, levantando sérias questões sobre ética e segurança no universo digital.

A Ascensão dos 'Modelos de Rosto de IA' nos Golpes

A descoberta da WIRED aponta para dezenas de canais no aplicativo de mensagens Telegram que atuam como intermediários para esses recrutamentos. Os anúncios oferecem ‘empregos’ para modelos, cuja função principal parece ser a de fornecer uma presença humana crível para os golpistas. Embora os detalhes exatos de como esses modelos são utilizados variem, a finalidade é clara: enganar vítimas e extorquir dinheiro. A expressão ‘100 videochamadas por dia’, mencionada no título original da reportagem, sugere a escala e a intensidade dessa operação, indicando que essas pessoas estão envolvidas em um volume massivo de interações, provavelmente para dar autenticidade a perfis falsos.

Como a Tecnologia e a Humanidade se Misturam em Esquemas Fraudulentos

Este novo tipo de fraude se aproveita da credibilidade que uma pessoa real pode emprestar a um esquema, mesmo que a operação subjacente seja automatizada ou gerida por IA. Existem algumas maneiras pelas quais esses ‘modelos de rosto de IA’ podem ser empregados:

Deepfakes e Personas Sintéticas

É possível que as modelos forneçam material de vídeo e áudio para treinar sistemas de deepfakes, que posteriormente seriam usados para criar avatares convincentes. A partir daí, a IA pode interagir com as vítimas, simulando uma pessoa real, seja em videochamadas pré-gravadas ou em tempo quase real. Outra possibilidade é que a própria modelo faça videochamadas rápidas, estabelecendo uma conexão inicial, enquanto a IA ou outros golpistas assumem o controle da conversa por texto ou áudio.

Golpes Românticos e de Investimento

Muitos desses esquemas se encaixam na categoria de ‘pig butchering’ (abate de porcos), onde golpistas constroem relações de confiança com as vítimas, muitas vezes românticas, para depois convencê-las a ‘investir’ em plataformas falsas. A presença de um rosto humano, especialmente de uma pessoa atraente, pode ser crucial para construir essa confiança inicial e manter a vítima engajada, tornando o golpe muito mais difícil de ser detectado.

Impactos na Sociedade Digital e na Reputação da IA

A exploração de modelos humanas para fraudes digitais traz consequências graves em diversas frentes:

Para as Vítimas

Além das perdas financeiras, as vítimas desses golpes frequentemente sofrem traumas psicológicos profundos, sentindo-se traídas e humilhadas. A sofisticação desses ataques dificulta a recuperação e a confiança em interações online futuras.

Para a Percepção da Inteligência Artificial

Casos como este mancham a imagem da Inteligência Artificial, associando-a a fraudes e manipulações. Isso pode gerar desconfiança generalizada na tecnologia, dificultando a adoção de inovações legítimas e benéficas. É essencial que a comunidade de AI e os reguladores trabalhem na segurança e na ética do desenvolvimento e uso da tecnologia.

Para Plataformas e Desenvolvedores

Plataformas como o Telegram enfrentam o desafio contínuo de monitorar e remover conteúdos e canais fraudulentos. Desenvolvedores de Large Language Models (LLMs) e outras tecnologias de IA precisam investir ainda mais em ferramentas de detecção de fraude e em diretrizes éticas robustas para evitar o uso indevido de suas criações.

Conclusão: Vigilância Constante no Cenário Digital

O recrutamento de ‘modelos de rosto de IA’ para golpes digitais é um lembrete sombrio da adaptabilidade dos criminosos e da importância da vigilância no ambiente online. Enquanto a Inteligência Artificial continua a evoluir, é fundamental que usuários, plataformas e reguladores estejam atentos às novas táticas de fraude. A educação digital e a desconfiança saudável são ferramentas cruciais para se proteger contra esses esquemas cada vez mais sofisticados, que usam tanto a tecnologia quanto a exploração humana para enganar.

Gostou da notícia? Inscreva-se na nossa newsletter para receber as principais novidades sobre inteligência artificial diretamente no seu e-mail.

Fonte: https://www.wired.com