A crescente complexidade dos agentes de Inteligência Artificial, especialmente aqueles que utilizam a Geração Aumentada por Recuperação (RAG – Retrieval Augmented Generation), torna sua avaliação um desafio crucial. Para garantir que esses sistemas funcionem de maneira confiável, eficiente e alinhada aos objetivos, ferramentas de teste robustas são indispensáveis. Este artigo explora duas abordagens poderosas: RAGAs e G-Eval, oferecendo um guia prático sobre como utilizá-las para validar a performance dos seus agentes de IA.

O Que São Agentes de IA e a Importância da Avaliação

Agentes de IA são sistemas projetados para perceber seu ambiente, tomar decisões e executar ações de forma autônoma para atingir objetivos específicos. Eles podem variar de chatbots simples a sistemas complexos de automação. Com a evolução dos Large Language Models (LLMs), muitos agentes agora incorporam o RAG para acessar e integrar informações externas, tornando-os mais precisos e menos propensos a ‘alucinações’. No entanto, essa capacidade adicional introduz novas camadas de complexidade na avaliação de sua qualidade e confiabilidade.

A Complexidade da Geração Aumentada por Recuperação (RAG)

O RAG é uma técnica que permite aos LLMs complementar suas respostas buscando informações relevantes em uma base de conhecimento externa antes de gerar a saída final. Isso é fundamental para manter as respostas atualizadas e factuais. Contudo, avaliar um sistema RAG exige mais do que apenas verificar a qualidade da resposta final; é preciso analisar a relevância da recuperação do contexto, a fidelidade da resposta ao contexto e a pertinência da resposta à consulta original. É aqui que ferramentas especializadas se tornam essenciais.

Por que a avaliação tradicional é insuficiente?

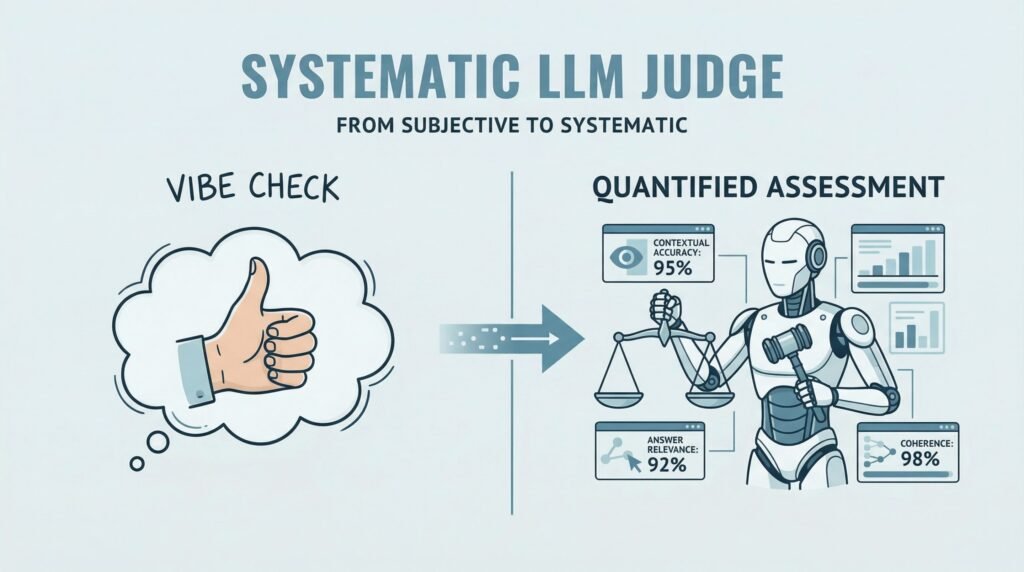

Métodos de avaliação tradicionais, muitas vezes baseados em métricas de concordância de palavras ou avaliações humanas subjetivas, podem ser ineficazes ou caros para agentes RAG. A natureza generativa dos LLMs produz respostas variadas, dificultando a comparação direta. Além disso, a capacidade de buscar e integrar contexto adiciona uma dimensão de avaliação que vai além da simples precisão textual.

RAGAs: O Kit de Ferramentas Essencial para Avaliação de RAG

RAGAs (Retrieval Augmented Generation Assessment) é um framework de avaliação que foca em métricas específicas para sistemas RAG. Ele automatiza a medição de aspectos críticos do desempenho, garantindo que o agente não apenas gere respostas coerentes, mas que também utilize o contexto recuperado de forma eficaz. Você pode encontrar a documentação oficial do RAGAs para mais detalhes.

Métricas essenciais do RAGAs

O RAGAs avalia o sistema RAG através de várias lentes, incluindo:

Ao utilizar o RAGAs, desenvolvedores podem identificar gargalos no pipeline RAG, como uma recuperação de documentos ineficiente ou um LLM que não sintetiza o contexto adequadamente.

G-Eval: Avaliação Guiada por Modelos de Linguagem

G-Eval é uma abordagem que utiliza um Large Language Model (LLM) para avaliar outro LLM ou agente de IA. Em vez de depender de métricas fixas ou anotações humanas extensivas, o G-Eval instrui um LLM avaliador a julgar a qualidade das respostas geradas com base em critérios fornecidos. Isso oferece uma flexibilidade enorme, permitindo a criação de rubricas de avaliação personalizadas e complexas.

Como o G-Eval utiliza LLMs

A principal vantagem do G-Eval é sua capacidade de capturar nuances e aspectos subjetivos da qualidade da resposta que são difíceis de quantificar com métricas automáticas tradicionais. No entanto, é crucial escolher um LLM avaliador competente e formular prompts de avaliação claros para evitar vieses e garantir a consistência.

Integrando RAGAs e G-Eval para uma Avaliação Robusta

A combinação de RAGAs e G-Eval oferece uma estratégia de avaliação poderosa. Enquanto o RAGAs fornece métricas objetivas e automatizadas focadas na integridade do pipeline RAG, o G-Eval adiciona uma camada de avaliação mais qualitativa e adaptável, capaz de julgar aspectos como coerência, fluidez, estilo e adequação geral da resposta a contextos complexos.

Desenvolvedores podem usar o RAGAs para testes contínuos e regressão, identificando rapidamente degradações no desempenho técnico do RAG. Paralelamente, o G-Eval pode ser empregado para avaliações mais aprofundadas em fases de desenvolvimento ou para cenários críticos, onde a nuance da resposta é primordial.

Impacto no Desenvolvimento e Mercado de IA

A adoção de ferramentas como RAGAs e G-Eval tem um impacto significativo em diversas frentes:

O Que Esperar nos Próximos Meses

A área de avaliação de LLMs e agentes de IA está em constante evolução. Espera-se que ferramentas como RAGAs e G-Eval continuem a ser aprimoradas, com a adição de novas métricas, integração com outras plataformas e maior facilidade de uso. A pesquisa em técnicas de avaliação mais robustas, escaláveis e alinhadas aos valores humanos será uma prioridade, impulsionando a próxima geração de aplicações de IA confiáveis.

A avaliação de agentes de IA, especialmente aqueles que utilizam RAG, é um pilar fundamental para o sucesso de qualquer aplicação baseada em LLMs. Ferramentas como RAGAs e G-Eval oferecem abordagens complementares e poderosas para garantir a qualidade, fidelidade e relevância das respostas geradas. Ao integrar essas metodologias no ciclo de desenvolvimento, desenvolvedores e empresas podem construir sistemas de IA mais robustos, confiáveis e capazes de entregar valor real. A adoção dessas práticas é um passo essencial para desbloquear todo o potencial da inteligência artificial de forma responsável.

Gostou da notícia? Inscreva-se na nossa newsletter para receber as principais novidades sobre inteligência artificial diretamente no seu e-mail.